こんにちは。

本日はこちらのWebサイトにお越しいただき、ありがとうございます。

このブログは生成AIの魅力にどハマりして、毎日のように生成AIを触っている私が、ChatGPT(チャットGPT)って何がいいのかわからないという友人に面白さや今後の可能性を伝えたいと思って立ち上げました。

2023年は「生成AI元年」。衝撃的なChatGPTのデビュー以来1年、2024年3月の段階でも、多くのことで使われるようになってきました。しかも、開発スピードは衰えることなく精度が向上し、使用範囲はますます広がることが予測されています。

反面、開発スピードが速いことで、法整備が追いついていないなどの問題も指摘されています。

この記事では、生成AIのメリットだけではなく、デメリットにも焦点を当てて、実際に使う際の対応策についてもまとめました。

生成AIのメリット

生成AIのメリットは、主に以下の点があげられます。

生成AIのメリットは、主に以下の点があげられます。

- 効率化による時間の削減

- 作業の一部の自動化による人手不足の解消

- 専門技術のハードルの低下

- 顧客との関係性の向上

効率化による時間の削減

例えば、メール文章や業務マニュアルの作成などは、人が行っていた10分の1、100分の1の時間で行うことが可能です。実際に画面に表示される文字の速さもタイピング能力の数十倍の速さで出力されていきます。

作業の一部の自動化による人手不足の解消

カスタマーセンターの業務の一部を生成AIによるチャットボット(自動応答システム)などで代用する。

ホテル等宿泊施設の清掃ロボット、レストラン等の配膳ロボットなどの導入。コロナ禍の感染対策としても接触頻度を極力少なくすることもできました。

専門技術のハードル低下

画像生成AIは、絵心がない人でも、適切な指示文によりプロが描いたようなクオリティのイラストを作成することができます。

作業者による品質のバラツキを押さえることもできます。

顧客との関係性の向上

顧客の行動を学習し、個人の嗜好などに対応することが可能となるため顧客満足度の向上が期待できます。

よくある問題やミスなどを学習することでも、事前に問題を回避することができるようになります。

生成AIのデメリット

メリットの多い生成AIですが、デメリットとして以下の点があげられます。

メリットの多い生成AIですが、デメリットとして以下の点があげられます。

- 指示が難しい

- 事実と異なるデータを作成してしまう

- 著作権を侵害している可能性がある

- 人間の仕事が減ってしまう

- フェイク画像や誤った情報の生成

- フェイクコンテンツによる悪用

- 責任の所在が不明確

- 情報漏洩のリスク

指示が難しい

生成AIは同じ質問をしても違う回答が出てくるくらい確実ではないです。

人は会話の間を読み解いて会話を続けることができますが、生成AIは会話を数字化して学習した内容から返す機械なので、言葉のニュアンスを掴んで会話をすると言うことはできません。

事実と異なるデータを作成してしまう

ChatGPTは「ツチノコ」は知ってますが「つちのこ」は知らないそうです。試しに、つちのことひらがなで聞いてみたところ、「つちのこ」という言葉は一般的には、「土の中で暮らす小さな生物」を指します。と答えました。

このように知らないことを知ったかぶりして会話を続けてしまうことがあるため、結果事実と異なるデータになることがあります。

著作権を侵害している可能性がある

生成AIの既存の著作物を学習データ活用することは、原則として著作権者の許諾なく可能とされています。(生成AIで作成したものに著作権は発生しない。)

但し、一方で、生成AIによって生成されたコンテンツの公開や販売をする際には、基本的には通常の著作権侵害の検討が適用されます。

また、著作権侵害は、既存の著作物への依拠性(既存の著作物をもとに創作したこと)がある場合にのみ認められています。

2024年2月29日に公開された文化庁の「AIと著作権に関する考え方について(素案)」

生成されたコンテンツに、既存のコンテンツとの類似性や依拠性が認められれば、著作権の侵害にはならなくても不法行為責任などになる可能性がある。

人間の仕事が減ってしまう

AIが普及することにより、人間の仕事が少なくなることが懸念されています。

フェイク画像や誤った情報の生成(ディープフェイク)

日本でも2022年に静岡で水害が発生したような画像をAIで生成し、それをフェイク情報としてSNSで拡散されました。

画像の高精細化技術も向上し、静止画であれば本物の写真かAI生成画像か、人間の目で見分けるのは困難になっています。

責任の所在が不明確

医療現場において診断をAIに任せているなかで診断ミスがあった場合、その責任がAI開発責任者なのか、AIの利用を決めた病院、AIによる診断を伝えた医師のいずれにあるのかを明確にするのは困難です。

情報漏洩のリスク

入力した情報は、AI の学習材料として活用されます。そのため、個人情報や機密情報を入力してしまうと、その情報が第三者の問い合わせに対する回答などに使用される可能性があり、情報漏洩のリスクを高める危険性があります。

その他

・学習データのボリュームが少ない場合、内容に偏ったアウトプットが生成されてしまうリスクが指摘されています。

・生成AIを過信することで、誤った情報のまま契約を結んでしまうなどのトラブルが発生。

デメリットに対しての対応策

指示が難しいことに対しての対応策

指示をする際に、基本の3つのポイントを抑えるという方法があります。

- 役割を与える

- タスクを詳細に伝える

- 細かい条件を補足して的外れな回答を防ぐ

事実と異なるデータを作成してしまうことへの対応策

・AIの生成した結果を鵜呑みにしない。

・追加学習をすることで知識を追加する。

著作権を侵害している可能性があることへの対応策

依拠性が認められることを避けるためにも、指示をするときに特定の作品の一部または全部を入力しない、といったルールの下、生成AIを利用するようにする。

人間の仕事が減ってしまうことへの対応策

しかしAIが新しく作業をすることで新しく生まれる仕事があります。

例えば、AIを活用するためのデータサイエンティストのような職種の雇用ニーズは、今後増加していくと言われています。

フェイク画像や誤った情報の生成への対応策

偽ニュースにだまされにくくなる「ファクトチェック」を紹介します。

- 情報の発信者は何者か

- 誰かが間違いを指摘していないか

- 報道や政府発表と違いがないか

- 正確に引用されているか「4つの検証ステップを知れば、偽ニュースにだまされにくくなる」

- 発見元を見る

- リプライ、コメントなどで指摘していないかを確認

- メディア・公的機関・当事者の発信を確認

- 正確に引用されているか(ソース元のを確認)

出典元:日本ファクトチェックセンターの古田大輔編集長による

「JFCファクトチェック講座3:検証の4ステップ 「横読み」で効率的に」

責任の所在が不明確への対応策

・AI提供者と消費者間の取引では、提供者が適切な事前・事後対策を取る。

・AI利用者も適切なリテラシーを身に着ける。

法律で明確な線引きが行われていない分野は多くあるため、リスクとして捉える。

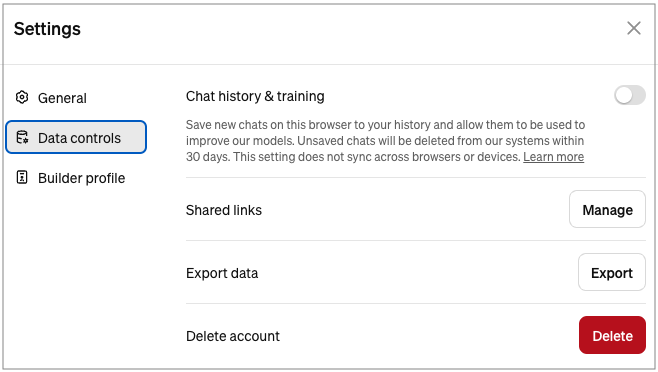

情報漏洩のリスクへの対応策(2024.4追記情報あり)

AIを活用する際は専門知識を持った担当者を常駐する。

生成AI を利用する時は、個人情報や機密情報を入力しないように運用を徹底する。

情報漏洩対策として、ChatGPTに学習させない設定方法があります。

※1 その場合でも不正利用の有無を調査する理由で履歴データは30日間保持されます。

※2 過去のチャット履歴自体も保存されないため、後から見返すことができなくなります。(過去履歴が見れるようにする方法が見つかりましたが、長くなりそうなので、後日別記事でお伝えします。)

設定方法

- ChatGPTのアカウントをクリックし、Setting(設定)を開く。

- Data Contorols(データコントロール) をクリック

- Chat history & training (チャット履歴・学習)をOFF(グレーにする)

まとめ

最初に述べたように、生成AIは開発スピードに対して世の中が追いついていないことでのリスクも多いと言われています。

だからと言って、拒否反応を示してしまい使わないと言うのは間違っています。それは今後、電気のように当たり前になる技術を避けることになるのです。

「今すぐ行動すべきでしょう。人類の進化の源泉は願望にある。強い願望が人類の未来をAGIとともに作る。敵ではなく味方としてあらゆる進化を遂げる。活用するのか、取り残される金魚になりたいのか。日本よ、目覚めよ。」

次回はChatGPTを実際に登録して使ってみます!